-

《人工智能》目录

-

前言

-

数据中心

-

理论知识

-

基本安装

-

基本知识

-

Transformer

-

脉冲神经网络 (SNN)

-

数据处理

-

声音处理

- FunASR:阿里的语音识别

- Kaldi:ASR,语音识别,可以训练声学模型

- 星辰语音识别开源大模型:中国电信,【超多方言】ASR

- 最难方言温州话被攻克!中国电信语音大模型支持30种方言

- 播放音频文件

- 让 Python 来帮你朗读网页吧

- 从零开始搭建一个语音对话机器人

- Seed-TTS:字节发布高性能高逼真语音合成框架

- ChatTTS:语音合成

- edge-tts:语音合成,调用的微软edge的在线语音合成服务

- pyttsx3:语音转换

- python实现TTS离线语音合成

- StyleTTS2:one-shot语音风格迁移和逼真语音转换的论文阅读和代码实战

- Matcha-TTS:语音合成,

- Bailing-TTS:巨人网络支持普通话和方言混说的TTS大模型

-

图像处理

-

视频处理

-

文字处理

-

多模处理

-

动态记忆和自我反思

-

论文精选

-

大模型LLM

-

AIAgent

- 新一代AI模型Claude 3:有大学生智商,全面超越GPT-4

- FastChat——一个用于训练、部署和评估基于大型语言模型的聊天机器人的开放平台

- 谷歌DeepMind推出新一代药物研发AI模型AlphaFold 3

- LangChain-Chatchat (原 Langchain-ChatGLM)

- MaxKB本地私有大模型部署

- YOLO v10视觉目标检测算法本地端部署

- Fay数字人框架 助理版

- 百度开源 / Senta - 情感分析旨

- Moshi:法国的ai研究者Kyutai推出开源实时语音多模态模型

- GraphRAG:微软开源 的下一代 RAG 技术

- Move AI 推出 Move API,实现 2D 视频转 3D 运动数据

- Cloudflare 推出一键阻止 AI 机器人的新工具

- 腾讯开源混元 Captioner 模型,优化文生图数据集生成

- 改变答题顺序会显著降低大模型准确率

- OpenDevin:卡内基梅隆大学教授创立 All Hands AI,推出开源 AI 软件代理 OpenDevin

- 漆远创立无限光年,获阿里投资进军可信大模型赛道

- 阿里发布 FunAudioLLM 开源项目,推出 SenseVoice 和 CosyVoice 两大语音模型

- 快手文生图大模型 Kolors 宣布开源

- 商汤科技发布 InternLM-XComposer2.5 视觉语言模型

- 穹彻智能推出具身大脑 Noematrix Brain,聚焦操作物理常识与行为决策

- 华中科技大学等团队推出 Holmes-VAD,实现视频异常检测与解释

- 可灵AI/Kling:快手视频生成大模型 可灵 AI Kling

- 彻底改变语言模型:全新架构TTT,ML模型代替RNN隐藏状态

- 新型TTT架构诞生,能否取代Transformer和Mamba成为最强大模型?

- DG4D/DreamGaussian4D:四维建模及运动控制模型

- CosyVoice:阿里的语音生成,支持多语言、音色和情感控制

- SenseVoice :阿里语音识别、语种识别、情感识别、声学事件分类或检测

- Seed-TTS:字节的的语音生成,太逼真太形象了

- Fish-Speech:开源的TTS项目,语音生成

- ollama:大模型运行平台,支持cpu运行大模型

- 当实时数字人遇上LLM

- CMD 下的基本指令

- 语音对话大模型:借助阿里的FunAudioLLM搭建语音对话模型

- CogVideo:智谱版Sora开源爆火,4090单卡运行,A6000可微调

-

功能模块

softmax函数归一化指数函数

正文

1. Softmax 的定义

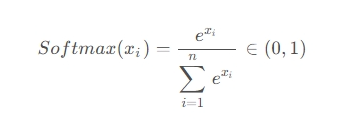

softmax函数又称归一化指数函数,是基于 sigmoid 二分类函数在多分类任务上的推广;在多分类网络中,常用 Softmax 作为最后一层进行分类。

Softmax 的计算公式如下:

2. Softmax 使用 e 的幂次的作用

对比普通的 max() 方法,Softmax 的独特之处就是使用的 e 的幂函数,其目的是为了两极化:

Softmax 可以使正样本(正数)的结果趋近于 1,使负样本(负数)的结果趋近于 0;且样本的绝对值越大,两极化越明显。

2.1 代码验证

(1)先用 numpy 来验证一下:

import numpy as np

# 计算向量 x 的 softmax

def softmax(x: list) -> list:

exps = np.exp(x)

return list(exps / np.sum(exps))

if __name__ == '__main__':

input = [-2, -1, 0, 1, 2]

output = softmax(input)

output = [float('{:.4f}'.format(i)) for i in output]

print(f"{output}")

对比两组输入输出:

(1) input = [-0.5, -0.2, 0, 0.2, 0.5] output = [0.1145, 0.1546, 0.1888, 0.2307, 0.3114]

(2) input = [-5, -2, 0, 2, 5] output = [0.0, 0.0009, 0.0064, 0.0471, 0.9456]

可以明显看到, x 的数值分布越不均匀,则 S o f t m a x ( x ) Softmax(x)Softmax(x) 的两极化越明显 在上面第二个 input 中, -5 对应的输出已经非常接近0,而 5 对应的输出已经接近 0.95

Softmax 可以使数值较大的值获得更大的概率

(2)再看看 PyTorch 中的 Softmax 函数:

import torch

import torch.nn as nn

input = torch.Tensor([-0.5, -0.2, 0, 0.2, 0.5])

softmax = nn.Softmax(dim=0)

output = softmax(input)

print(output) # tensor([0.1145, 0.1546, 0.1888, 0.2307, 0.3114])

可以看到 PyTorch 的计算结果与我们自己用 numpy 算的是一致的。

2.2 数学原理分析

从数学原理上分析,是因为当 x 的数值分布越不均匀时,e m a x ( x i ) e^{max(x_i)}e

max(x i)与 ∑ i = 1 n x i \displaystyle \sum^{n}_{i=1}{x_i} i=1∑n x i

非常接近,导致 S o f t m a x ( m a x ( x i ) ) → 1 Softmax(max(x_i)) \rightarrow 1Softmax(max(x i ))→1 ,而 S o f t m a x ( m i n ( x i ) ) → 0 Softmax(min(x_i)) \rightarrow 0Softmax(min(xi))→0

3. 解决 Softmax 的数值溢出问题

3.1 什么是数值溢出?

数值溢出是 Softmax 函数经常遇到的问题,数值溢出包括数值上溢和下溢两张情况:

(1)上溢:数值较大的数据经过一些运算后其数值非常大,以至于超过计算机的存储范围而无法继续运算,在程序中表现为 NAN

(2)下溢:非常接近0 的数据被四舍五入为 0,从而产生毁灭性的舌入误差。

3.2 解决数值上溢问题:x i − m a x ( x ) x_i-max(x)xi−max(x)

由于 Softmax 中存在 e 的幂次,这将很容易导致数值溢出问题:

(1)当 x i → − ∞ x_i \rightarrow -\inftyxi→−∞时,S o f t m a x ( x ) Softmax(x)Softmax(x) 的分母将接近 0,导致 S o f t m a x ( x ) → 0 Softmax(x) \rightarrow 0Softmax(x)→0,会出现数值下溢问题。

(2)当 x i → + ∞ x_i \rightarrow +\inftyxi→+∞时,S o f t m a x ( x ) Softmax(x)Softmax(x) 的分子和分母都接近正无穷大,导致 S o f t m a x ( x ) Softmax(x)Softmax(x) 的结果是未定的。

依然首先通过代码来说明,可以看到:当输入数值较小时,Softmax 的输出为 0;而当输入数值较大时,Softmax 的输出为 nan

import numpy as np

# 计算向量 x 的 softmax

def softmax(x: list) -> list:

exps = np.exp(x)

return list(exps / np.sum(exps))

if __name__ == '__main__':

input = [-1000, -200, 0, 200, 1000]

output = softmax(input)

print(f"{output}") # [0.0, 0.0, 0.0, 0.0, nan]

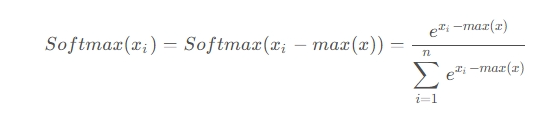

上述两个问题可以通过公式 (2) 同时解决:

简单推导一下就知道,S o f t m a x ( x i ) = S o f t m a x ( x i − m a x ( x ) ) Softmax(x_i)=Softmax(x_i-max(x))Softmax(x

i

)=Softmax(x

i

−max(x)) 是成立的;因为 Softmax 的函数值不会因为输入向量减去或加上一个标量而改变(标量在分子和分母中会抵消)。

将 x i x_ix

i

减去 m a x ( x ) max(x)max(x) 使得 exp 指数的最大参数 x i − m a x ( x ) x_i-max(x)x

i

−max(x) 为 0 ,这避免了数值上溢的可能。同时,分母中有一项是固定的 e m a x ( x ) − m a x ( x ) = 1 e^{max(x)-max(x)} =1e

max(x)−max(x)

=1,这保证分母不会为 0 ,避免出现分母奇异的情况。但公式 (2) 并不能避免分子为 0 从而导致数值下溢的情况。

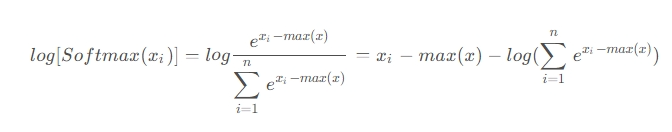

3.3 解决数值下溢问题:log_softmax

使用 x i − m a x ( x ) x_i-max(x)x

i

−max(x) 可以避免数值上溢,但不能完全解决数值下溢的问题。log_softmax 正是为了解决 softmax 中的数值下溢的情况;对公式(2)取对数得到 log_softmax 的表达式:

l o g [ S o f t m a x ( x i ) ] 中都是常数项,因此不会出现数值溢出问题。

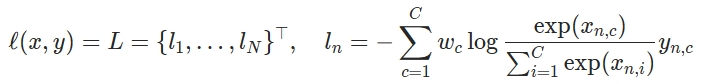

4. PyTorch 中 CrossEntropyLoss 与 Softmax 的关系

PyTorch 中 CrossEntropyLoss 的接口是 torch.nn.CrossEntropyLoss()

先说结论1:

nn.CrossEntropyLoss() 中已经集成了 Softmax,因此如果使用nn.CrossEntropyLoss() 作为损失函数,则网络的最后一层不需要也不能加 Softmax 层

nn.CrossEntropyLoss() 的官方介绍为 torch.nn.CrossEntropyLoss(),其计算公式为:

再说结论2:

nn.CrossEntropyLoss 是 nn.LogSoftmax 和 nn.NLLLoss 的组合

nn.LogSoftmax 就是 3.3 中讲的 log_softmax,nn.NLLLoss 其实就是先求和,再取负数。所以先做 LogSoftmax 再做 NLLLoss 其实就等价于直接做CrossEntropyLoss

使用 PyTorch 验证一下:

import torch

import torch.nn as nn

# 输入数据和 label

input = torch.Tensor([[-0.5, -0.2, 0, 0.2, 0.5]])

target = torch.tensor([0.35]).long()

log_softmax = nn.LogSoftmax(dim=1)

CEL = nn.CrossEntropyLoss()

NLL = nn.NLLLoss()

# CrossEntropyLoss

output_CEL = CEL(input, target)

print(f"output_CEL = {output_CEL}")

# LogSoftmax + NLLLoss

logSM_input = log_softmax(input)

output_NLL = NLL(logSM_input, target)

print(f"output_NLL = {output_NLL}")

"""

output_CEL = 2.1668357849121094

output_NLL = 2.1668357849121094

"""

可以看到,nn.CrossEntropyLoss 的计算结果与 nn.LogSoftmax + nn.NLLLoss 的组合计算结果完全相同。

本节参考资料:

Pytorch踩坑记之交叉熵(nn.CrossEntropy,nn.NLLLoss,nn.BCELoss的区别和使用)

Pytorch 中使用nn.CrossEntropyLoss的注意点(不需要额外的softmax)

原文地址

https://blog.csdn.net/qq_43799400/article/details/131202148?ops_request_misc=&request_id=&biz_id=102&utm_term=softmax&utm_medium=distribute.pc_search_result.none-task-blog-2~all~sobaiduweb~default-3-131202148.nonecase&spm=1018.2226.3001.4187